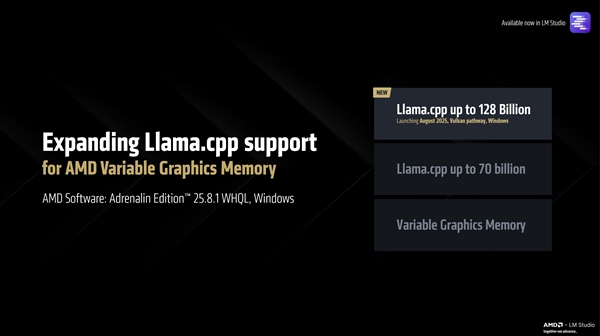

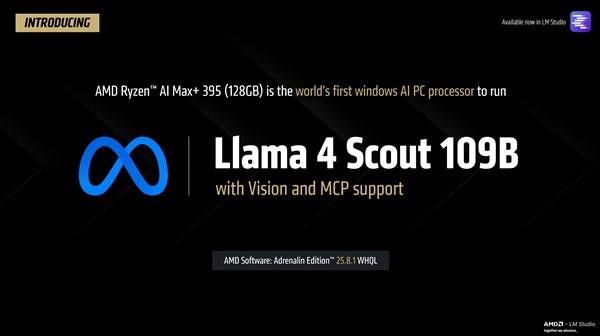

在智能技术领域,AMD再次以颠覆性创新引领行业,正式发布了基于全新Zen5架构的锐龙AI Max 395处理器。这款芯片不仅刷新了本地AI运算性能纪录,更成为全球首款能在个人设备上流畅运行700亿参数级大模型的平台。而最新升级显示,该处理器现已支持本地运行1280亿参数的AI模型,标志着消费级设备在大模型部署领域取得历史性突破。

要驾驭如此庞大的模型规模,硬件配置自然不容小觑。锐龙AI Max 395需要搭配128GB统一内存架构,其中96GB将专用于显存,以确保高效稳定的数据吞吐。平台需在Vulkan支持的llama.cpp环境下运行,这个开源框架为开发者提供了更灵活的调试与优化空间。

最令人瞩目的是,该平台成功实现了对1090亿参数的Meta Llama 4模型的本地部署,模型体积达66GB,不仅支持文本生成,还集成了视觉识别(Vision)与多任务协同处理(MCP)等前沿功能。

性能飞跃的背后是核心技术的革新。本次升级的关键在于引入混合专家(MoE)架构,通过动态激活特定模块而非全量加载,在保证响应速度的同时显著降低硬件资源占用。实测数据显示,锐龙AI Max 395在运行这些庞然大物时,仍能保持每秒15个token的稳定输出。

值得一提的是,该平台兼容性极强:既能运行1230亿参数的Mistral Large(68GB)等顶级模型,也能轻松应对300亿参数的Qwen3A3B(18GB)和270亿参数的Google Gemma(17GB)等中小型模型。

在处理复杂任务方面,锐龙AI Max 395实现了质的突破:

- 最大上下文长度扩展至256000个token

- 可一次性分析长篇技术文档、整本小说或海量代码库

- 常规应用在32000个token下已足够流畅

注意:尽管性能强大,但运行超大模型时仍需确保散热和供电稳定。

随着技术成熟和供应链优化,搭载锐龙AI Max 395处理器和128GB内存的迷你AI工作站,售价已降至约1.3万元人民币。这一亲民价格大幅降低了个人开发者和小型团队使用顶级大模型的门槛,有望加速AI技术在更广泛领域的创新应用。