科技巨头在人工智能领域的竞争愈发激烈,字节跳动最近以一场震撼的开源动作再次搅动AI行业格局。凭借抖音和今日头条站稳市场地位的这家公司,正式发布了全新自研大语言模型——Seed-OSS-36B。该模型不仅具备360亿的超大参数量,更原生支持512K超长上下文窗口,一推出就在开源社区引发广泛关注,迅速成为开发者群体中的热门话题。

要知道,当前主流开源模型的上下文长度大多还停留在128K水平,而Seed-OSS直接将上限提升至四倍。这一跨越式突破,为处理超长文本数据提供了前所未有的可能。相比DeepSeek-V3.1等同类模型,Seed-OSS在复杂任务处理上优势明显,堪称面向未来AI应用的重要布局。

Seed-OSS不仅是一次技术发布,更是字节跳动对大模型开源生态的战略性投入。

命名致敬经典,实则着眼长远

从命名不难看出,“Seed-OSS”明显致敬了OpenAI的GPT系列,既表达对行业先行者的尊重,也显示出字节进军通用大模型赛道的决心。但战略意图不止于此——公司并未直接开源其商业模型“豆包”,而是专门推出社区专用版本,体现出技术开放与商业保护之间的精妙平衡。

值得一提的是,该模型采用宽松的Apache 2.0开源协议,允许免费商用和学术使用。这种开放策略,有望吸引更多开发者参与其技术生态,推动社区共建。

512K上下文:突破AI的理解极限

原生支持512K上下文,并非简单增加参数,而是对模型认知能力的本质提升。这意味着它可以一次性理解整本小说、大型代码库、完整法律合同或数百页的科研论文,彻底解决以往因文本长度限制导致的信息断裂问题。

对于法律、金融、科研等依赖长文本分析的行业来说,这堪称工作方式的革命。律师可以使用AI通读整套并购文件,金融分析师能一键解析企业年报,程序员则可实现全代码级的智能调试与重构。

思考预算:让AI推理更精准可控

Seed-OSS引入了一项创新机制——“思考预算”(Token Budget)。用户可通过设定预算值,控制模型推理的深度与复杂度,实现响应速度与输出质量的灵活平衡。

比如处理简单问题时,可降低预算以提高响应速度;面对复杂推理时,则调高预算,让模型进行多步思考,确保答案严谨可靠。这一机制让用户真正实现“按需智能”,避免资源浪费。

技术底座:融合成熟与前沿

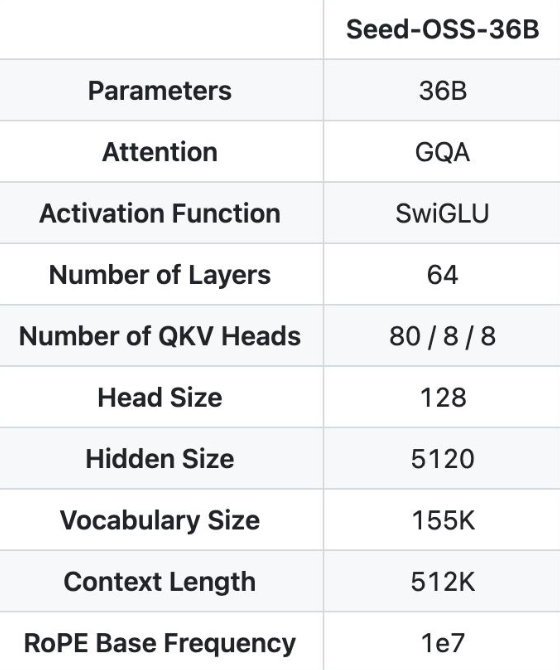

Seed-OSS在架构设计上融合了多项先进技术。其中包括增强长文本理解能力的RoPE(旋转位置编码),以及提升推理效率与稳定性的GQA(分组查询注意力)机制。

在多项权威测试中,该模型在知识问答、逻辑推理、数学计算等任务中表现卓越,多项指标刷新开源模型纪录,为其在实际业务中的落地提供了坚实支撑。

不止于语言:Seed团队的多模态布局

字节跳动的Seed团队自2023年成立以来,一直专注于大模型底层技术突破。除Seed-OSS之外,团队还推出了支持图像、视频多模态理解的BAGEL模型,展现出在跨模态学习领域的深厚积累。

这种“语言+多模态”并行推进的策略,显示出团队在构建AI技术生态方面的系统性眼光。

开源价值:助力中国AI生态发展

Seed-OSS的开源不仅是一次技术分享,更是对中国AI生态的重要加强。在全球AI竞争日趋激烈的背景下,国内企业主动开放先进模型,有助于提升我们在国际技术标准制定中的话语权。

为中国及全球研究者提供可商用、高质量的基础模型,将显著加速技术创新与应用落地的循环。

未来应用场景广泛可期

随着Seed-OSS在社区中的不断迭代,它在智能写作、自动摘要、代码生成、企业知识库构建等领域的潜力将逐步释放。尤其在需要深度长文本理解的垂直场景中,该模型有望成为新一代智能工具的核心引擎。

字节跳动通过此次开源,不仅秀出了技术肌肉,更传递出共建共享的发展理念。Seed-OSS有望成为推动国产大模型生态发展的一支重要力量,为AI普及化注入新动能。