影视圈从不缺少话题,但阿里国际近期推出的多模态大模型 Ovis2.5,却在内容创作领域掀起了一波新浪潮。这款模型不仅完全开源,还在技术性能上实现了显著突破,正悄然改变影视制作、视觉分析乃至内容分发的底层逻辑。作为 Ovis 系列的最新版本,Ovis2.5 凭借其原生分辨率视觉感知和深度推理能力的提升,迅速成为行业焦点。

此次发布的 Ovis2.5 推出两个版本,精准适配不同应用场景。其中,Ovis2.5-9B 在 OpenCompass 评测中斩获 78.3 的高分,不仅在 40B 参数以下的开源模型中排名第一,甚至超越了一些更大规模的竞品,展现出卓越的综合能力。另一款轻量级模型 Ovis2.5-2B 则获得 73.9 分,延续了“小身材、大能量”的设计理念,特别适合移动端或算力有限的设备,可高效支持影视后期、实时字幕生成等边缘计算场景。

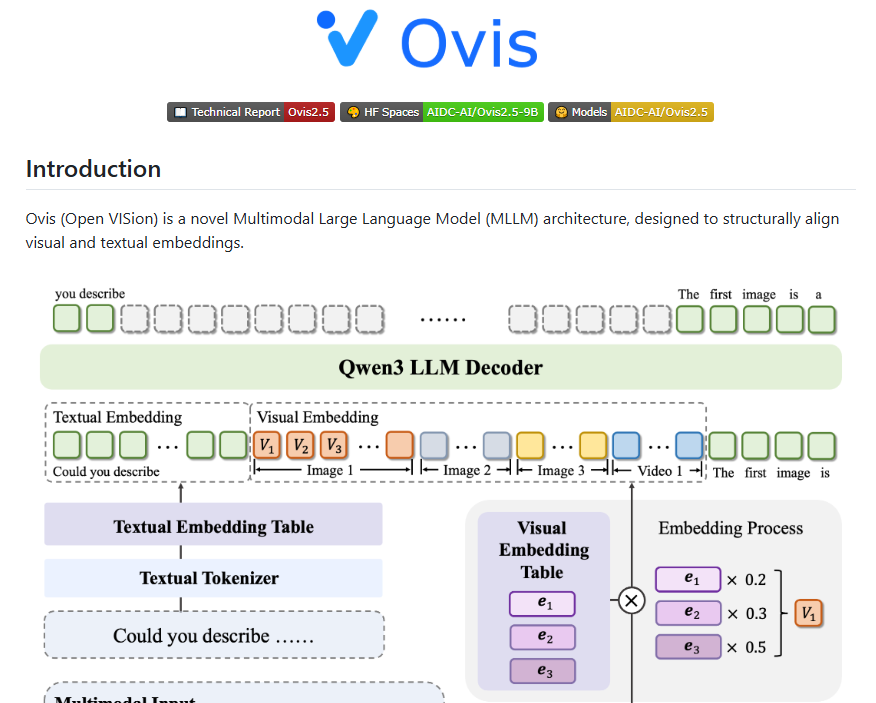

从架构上看,Ovis2.5 并非简单迭代,而是一次系统性革新。其核心仍由三大模块组成:支持动态分辨率的视觉特征提取系统,可精准解析不同画质的素材;创新的视觉词表模块,实现图像与文本的结构化对齐;以及基于 Qwen3 构建的语言理解引擎,大幅提升语义解析与叙事能力。这一组合让模型不仅能“看懂”画面,更能“理解”情节与情感。

训练策略方面,Ovis2.5 采用了更精细的五阶段流程,涵盖视觉预训练、多模态融合和指令微调等环节。值得一提的是,通过引入 DPO 和 GRPO 等先进算法,模型在人类偏好对齐和逻辑推理方面表现更出色。官方称整体训练效率提升了 3 至 4 倍,大幅缩短数据到模型的周期,为影视内容的快速生成与迭代提供有力支持。

数据层面,Ovis2.5 的训练集比前代扩充了50%,尤其加强了对视觉推理、图表解析、OCR 识别和视觉定位(Grounding)等关键能力的训练。值得注意的是,团队还合成了大量与 Qwen3 深度协同的“思考型”数据,使模型具备更强的反思和推演能力,可在复杂影视场景中识别隐含信息,甚至辅助剧本逻辑校验。

目前,Ovis2.5 的全部代码和模型权重已在 GitHub 和 Hugging Face 平台开放,创作者和开发者可自由下载使用,探索其在影视分析、智能剪辑、跨模态检索等领域的应用潜力。

代码:https://github.com/AIDC-AI/Ovis

模型:https://huggingface.co/AIDC-AI/

划重点:

🌟 Ovis2.5-9B 在 OpenCompass 中得分78.3,领跑同规模开源模型。

🔧 双版本设计,兼顾高性能与轻量化部署需求。

📊 架构、训练、数据三重升级,强化视觉理解与推理能力。