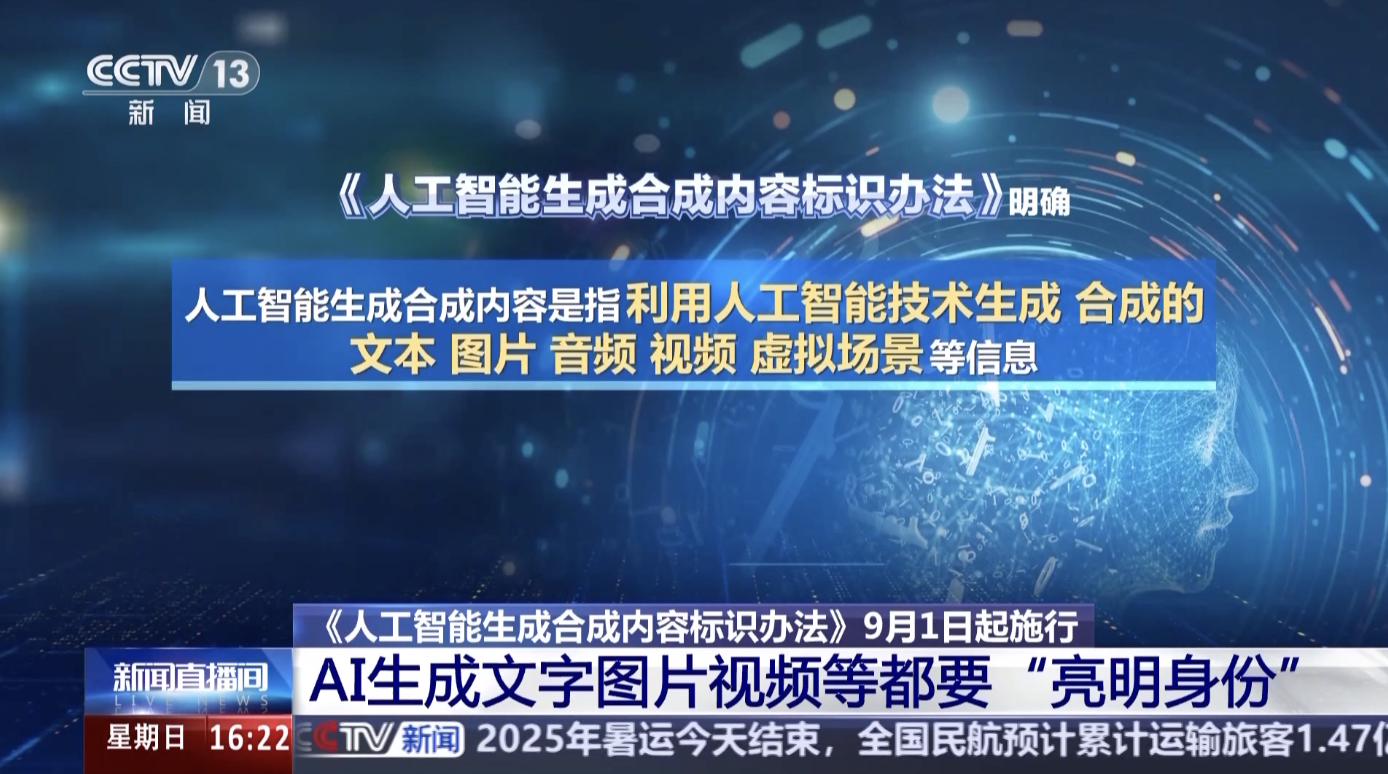

明天起,AI创作的内容将不能再“隐藏”身份。根据国家网信办、工信部、公安部及国家广播电视总局联合发布的《人工智能生成合成内容标识办法》,自2025年9月1日起,所有通过人工智能技术生成或合成的文字、图片、音频、视频等数字内容,都必须携带清晰可辨的“身份标签”,确保公众能够识别其来源属性。这一新规的落地,标志着我国在人工智能内容治理领域迈出了关键一步。

随着生成式AI和深度合成技术的迅猛发展,AI创作已渗透到影视、新闻、广告乃至社交等多个领域,极大丰富了网络内容生态,提升了内容生产效率。然而,技术的双刃剑效应也日益凸显:虚假新闻、深度伪造视频、误导性图文等内容层出不穷,严重扰乱网络秩序,损害公众知情权,甚至威胁社会安全。面对公众对信息真实性的强烈诉求,此次四部门联手推出《标识办法》,正是为了从源头上构建可信、透明的数字内容环境。

新规明确,AI生成内容的标识分为“显式”与“隐式”两种。显式标识要求服务提供者在内容呈现时,通过文字提示、语音播报、图形水印等方式,在文本、音频、图片或视频的显著位置进行标注,确保用户一眼可辨。例如,AI生成的视频需在播放起始画面或周边区域添加醒目标识;而AI合成的虚拟场景,也必须在进入时进行明确提示。隐式标识则更为“隐形”,它以技术手段将生成信息、服务提供者编码、内容编号等元数据嵌入文件内部,即便显式标识被删除,也能通过技术手段追溯来源。

值得注意的是,《标识办法》不仅约束内容生成平台,也对传播平台提出了责任要求。社交平台、内容分发网站等在用户发布内容时,需主动核验文件中的隐式标识,或根据用户声明、内容特征识别AI生成内容,并在发布界面周边添加提醒,防止虚假信息扩散。同时,平台还需提供便捷的标识功能,引导用户主动声明内容属性,形成全链条的监管闭环。

更为严格的是,任何组织或个人不得恶意删除、篡改或伪造AI标识,也不得提供相关工具或服务。一旦违规,将由网信、公安等主管部门依法追责。这不仅保护了内容的真实性和创作者的权益,也为后续的溯源追责提供了法律依据。可以预见,随着该办法的施行,AI内容将告别“无痕”时代,一个更加规范、透明、可信赖的智能内容生态正在加速成型。