2025年9月29日,一则来自社交媒体平台“X”的爆料在科技圈掀起波澜。用户Tibor Blaho发布动态指出,全球顶尖的人工智能企业OpenAI被曝出在未通知的情况下,悄然调整其付费用户的模型调用策略,引发大量用户不满与质疑。这场看似技术层面的调整,实则触及了用户信任与服务透明度的核心问题。

模型悄然更替,用户体验大幅缩水

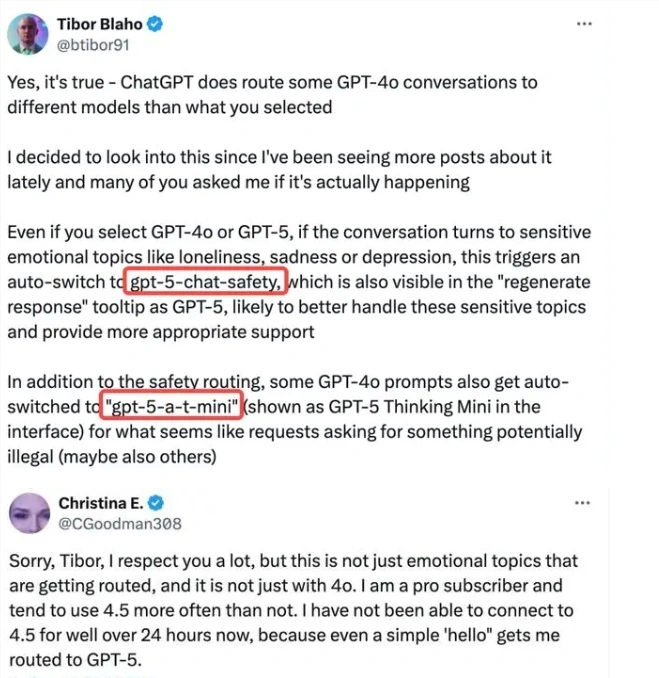

据多方反馈,OpenAI近期在未发布任何公告的前提下,将原本为订阅用户提供服务的GPT-4及GPT-5高阶模型,替换为两款鲜为人知的“内部模型”——gpt-5-chat-safety与gpt-5-a-t-mini。这两款模型虽在内容安全过滤方面有所强化,但算力与响应能力明显弱于原生版本。

不少长期订阅用户反映,在进行复杂提问或涉及敏感话题时,系统会自动触发模型切换机制,导致对话质量断崖式下跌。原本逻辑严密、信息丰富的回答变得机械、空洞,甚至频繁出现“无法回应”或“建议调整提问”的提示,极大影响了使用效率与体验。

一位从事内容创作的高级会员表示:“我每月支付不菲的费用,就是为了获得稳定、高质量的AI支持。但现在的情况是,我根本不知道自己用的是哪个模型,回答质量时好时坏,完全失去了可预期性。”

信任危机爆发,用户质疑服务诚信

此次“静默切换”迅速引发用户群体的强烈反弹。尽管OpenAI官方解释称此举是为了测试内容安全机制,防止模型被滥用,属于“常规技术优化”,但这一说法并未平息争议。

用户普遍认为,作为付费客户,他们理应享有对所购服务的知情权与使用权。在未提前告知、未提供选择的情况下擅自降级服务配置,无异于变相缩减服务承诺,涉嫌侵犯消费者权益。

“这不是技术优化,这是偷偷降配。”一位资深开发者在论坛中直言,“如果连基础的服务一致性都无法保障,那所谓的‘高级订阅’还有什么意义?”

行业通病浮现,透明度成AI服务软肋

OpenAI的此次风波,暴露出当前AI服务行业普遍存在的深层问题:算法黑箱化、策略不透明、用户被动接受。许多AI平台在模型调度、资源分配、功能限制等方面缺乏清晰说明,用户往往在不知情的情况下遭遇服务降级或功能阉割。

这种“后台操作”模式虽便于企业进行技术迭代与风险控制,却严重削弱了用户的掌控感与信任度。长此以往,不仅损害品牌声誉,更可能阻碍整个行业走向成熟与规范化。

重建信任,需从尊重用户开始

此次事件为整个AI产业敲响警钟。技术进步不应以牺牲用户权益为代价。企业必须在安全管控与服务透明之间找到平衡点,建立明确的告知机制与用户选择机制。

未来,AI服务商应主动公开模型调用规则,允许用户查看当前运行的模型版本,并提供“稳定模式”或“安全优先”等可选项,让用户真正掌握使用主动权。同时,监管机构也需加快制定AI服务标准,明确平台责任边界。

对用户而言,也应提升对AI服务条款的关注度,在享受智能便利的同时,保持理性判断与权利意识。唯有平台与用户双向奔赴,AI生态才能走向健康、可持续的未来。

这场风波终将过去,但它留下的思考不应被遗忘:在算法主导的时代,人的知情权与选择权,永远不该被“静默更新”所掩盖。