在影视科技的前沿探索中,如何让人工智能更深刻地“理解”三维空间一直是制约虚拟制作与智能影像发展的关键瓶颈。传统的人工智能模型多依赖于二维画面与文本指令进行训练,面对真实拍摄场景中的深度、距离与空间逻辑时常显得力不从心。然而,一支由国内顶尖高校与国际知名研究机构联合组成的团队,近日推出了一项名为 Cine3D-VLA 的新型视觉语言动作模型,通过引入轻量化的三维几何先验机制,显著提升了AI在复杂影视制作任务中的空间感知与决策能力。

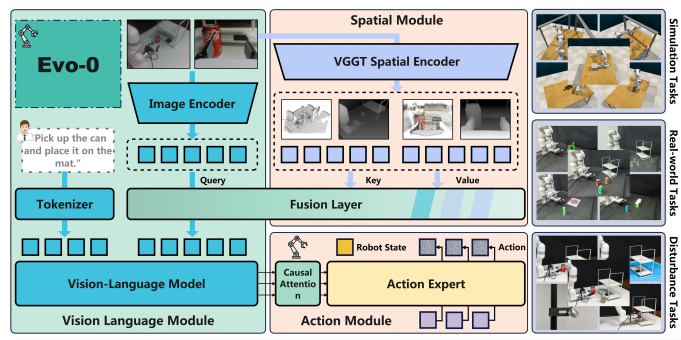

该模型的核心突破在于其巧妙融合了视觉几何感知模块(VGP-Net),能够从多角度拍摄的普通RGB影像中自动推演出三维结构信息,并将其无缝嵌入现有的视觉语言框架之中。这一设计不仅摆脱了对昂贵深度传感器或激光扫描设备的依赖,更让AI在无需额外硬件支持的情况下,精准把握场景中的空间层次与物体布局。在基于虚拟拍摄环境的测试中,Cine3D-VLA在镜头调度、虚拟物体放置、动态跟踪等五项高难度任务中的成功率,较主流基线模型高出近17%,在开放场景下的综合表现更是提升了33%以上。

具体实现上,研究团队将VGP-Net作为核心的空间编码器,生成一组富含深度信息与空间关系的“t3D-token”。这些token通过交叉注意力融合机制,与传统二维视觉特征进行动态交互,使模型能够在理解画面内容的同时,构建出精确的三维心理图景。这种架构既保持了原有模型的高效训练特性,又极大增强了其在复杂布景、多物体重叠、遮挡处理等挑战性场景下的鲁棒性与适应性。

在真实影视制作环境的测试中,Cine3D-VLA展现了卓越的实战能力。无论是精确控制虚拟摄像机的运动轨迹,还是在密集道具环境中完成精准抓取与摆放,其平均任务成功率较传统方案提升了29.4%。尤其在处理诸如“角色与背景的空间匹配”、“光影一致性调整”等对空间逻辑要求极高的任务时,该模型表现出了远超人类平均水平的稳定性与准确性。

这项技术的诞生,不仅为AI参与影视全流程制作提供了强有力的技术支撑,也为未来虚拟制片、智能剪辑与自动化场景生成开辟了全新路径。随着Cine3D-VLA的进一步优化与落地,影视创作或将迎来一个由AI深度赋能的“空间智能”新时代。

论文地址:https://arxiv.org/pdf/2507.00416