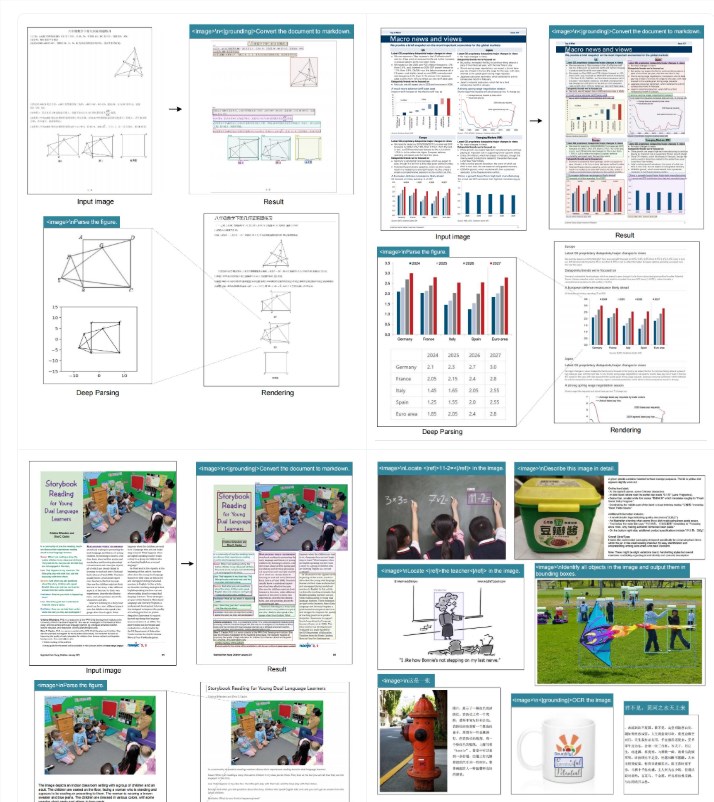

在人工智能技术日新月异的当下,DeepSeek公司再次掀起技术浪潮,正式发布了其最新研发成果——DeepSeek-OCR。这款全新的光学字符识别模型并非传统意义上的OCR工具,而是一款集成了视觉与语言能力的端到端视觉语言模型(VLM),旨在以更智能、更高效的方式重构文档解析的底层逻辑。

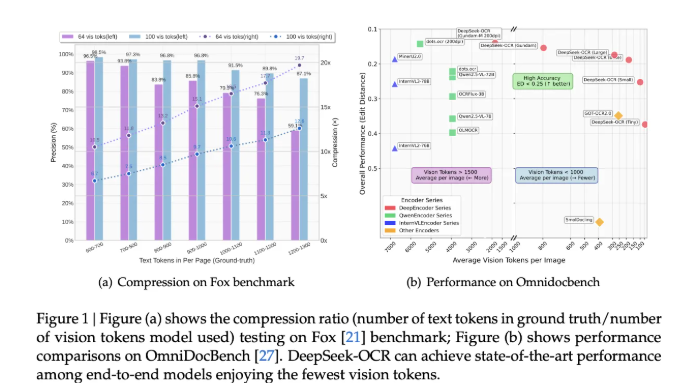

该模型的核心突破在于其独特的信息压缩与解码机制。通过将长篇幅文本内容压缩为极少数的视觉标记,再交由语言模型进行精准还原,DeepSeek-OCR实现了在保持高精度的同时大幅降低计算资源消耗。实测数据显示,其在Fox基准测试中达到了惊人的97%解码准确率。即便在文本标记与视觉标记比例高达10:1的情况下,模型依然稳定输出;更令人惊叹的是,在20倍的极端压缩比下,系统仍能保留关键语义特征,展现出极强的鲁棒性。

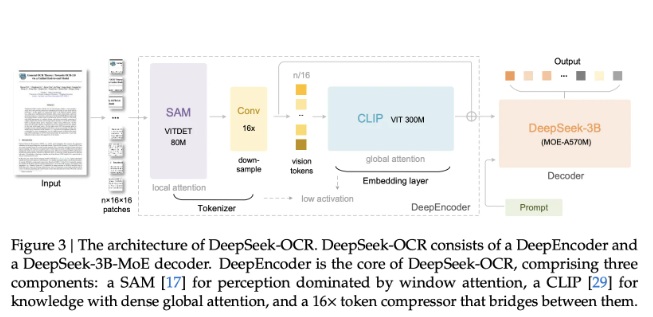

从架构设计来看,DeepSeek-OCR由两大核心模块构成:负责图像处理的DeepEncoder视觉编码器与承担语义解码任务的DeepSeek3B-MoE-A570M混合专家模型。前者采用创新的SAM局部感知窗口注意力机制,结合卷积压缩算法,有效缓解了高分辨率输入带来的内存压力,并显著减少了输出标记数量。后者则是一个参数规模达30亿的解码器,每处理一个标记时激活约5.7亿参数,确保了解码过程的精细度与准确性。

值得一提的是,DeepEncoder提供了丰富的运行模式选项,包括Tiny、Small、Base和Large四种固定配置,分别对应不同分辨率与标记预算,满足多样化应用场景。此外,系统还引入了名为Gundam与Gundam-Master的动态调节模式,可根据文档页面的复杂程度自动分配计算资源,实现性能与效率的动态平衡。

在训练策略上,研发团队采用了分阶段渐进式训练法:首先独立优化DeepEncoder的下一个标记预测能力,随后进行全模型联合训练。这一流程使得系统每日可生成并学习超过20万页高质量文档数据,极大提升了模型的泛化能力。官方建议用户在常规场景下优先使用Small模式,而在处理小字号密集排版或高信息密度页面时,则推荐启用Gundam动态模式以获得最佳效果。

DeepSeek-OCR的问世,不仅代表了OCR技术从“识别”向“理解”的关键跃迁,也为智能文档处理开辟了全新路径。其卓越的压缩效率与灵活的适配能力,预示着未来AI在办公自动化、数字档案管理、教育科技等领域的广泛应用前景。

论文:https://github.com/deepseek-ai/DeepSeek-OCR/blob/main/DeepSeek_OCR_paper.pdf

huggingface:https://huggingface.co/deepseek-ai/DeepSeek-OCR

划重点:

🌟 DeepSeek-OCR是一款30亿参数级视觉语言模型,重新定义高效文档解析标准。

📊 在Fox测试中实现97%精度,支持高倍率文本压缩下的稳定识别。

🔧 提供多分辨率模式与智能动态调节功能,适配复杂多变的文档场景。