自2022年底ChatGPT横空出世,AI热潮席卷全球,从底层算力、存储网络,到电力基建、边缘终端,几乎每个细分赛道都被资本轮番热炒。然而,三年过去,当英伟达、微软等AI基建“顶梁柱”在三季报中纷纷宣布史无前例的AI资本开支时,市场情绪却骤然转冷——投资者开始担忧:这轮AI投资是否已步入泡沫化阶段?

一边是芯片巨头赚得盆满钵满,另一边是模型厂商持续巨额亏损,融资消息层出不穷却又令人眼花缭乱。问题究竟出在哪里?产业链的真实盈利格局是否健康?本文将通过拆解核心企业的财务逻辑,尝试厘清AI产业当前的结构性矛盾,并判断泡沫是否已然形成。

一、利润分配严重失衡:上游吃肉,中游垫资,下游喝汤

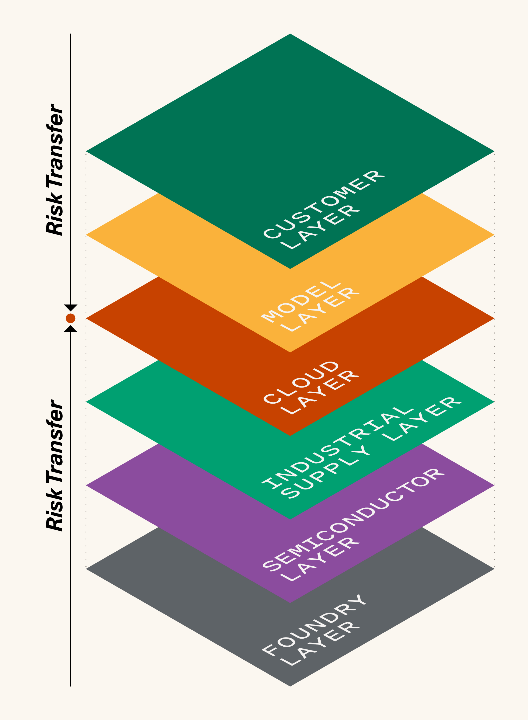

当前AI主产业链大致可分为五层:晶圆代工(如台积电)、算力芯片商(如英伟达)、云服务商(如微软Azure)、大模型公司(如OpenAI)以及终端应用场景。然而,这五层之间的利润分配极不均衡。

以云服务商为例,若其提供100元的AI云服务收入,其中约55元用于硬件折旧与运营成本(GPU占大头),10元为管理及研发费用,账面利润看似有35元。但关键在于,这100元收入背后,云厂商需提前投入约175元购置设备——尤其是英伟达GPU,占采购成本的70%以上。这意味着,云服务商虽有利润,实则现金流高度紧张,甚至需依赖资产抵押证券等方式融资维持扩张。

而英伟达作为上游“铲子商”,每100元云服务收入背后,就对应着约125元的GPU销售收入。凭借近乎垄断的市场地位和高达75%的毛利率,英伟达成为本轮AI基建的最大赢家。

反观下游的OpenAI,尽管月活跃用户已突破8亿,年化收入有望在2025年达到200亿美元,但其亏损更为惊人——据多方披露,其全年亏损或超150亿,若按微软持股比例推算,实际年化亏损可能高达300亿美元。原因很简单:高昂的云服务成本几乎吞噬了全部收入,导致“收入越高,亏得越狠”。

二、巨头博弈加剧:垂直一体化成破局关键

面对产业链利润向上游过度集中,各方开始寻求破局之道,核心策略便是“垂直一体化”。

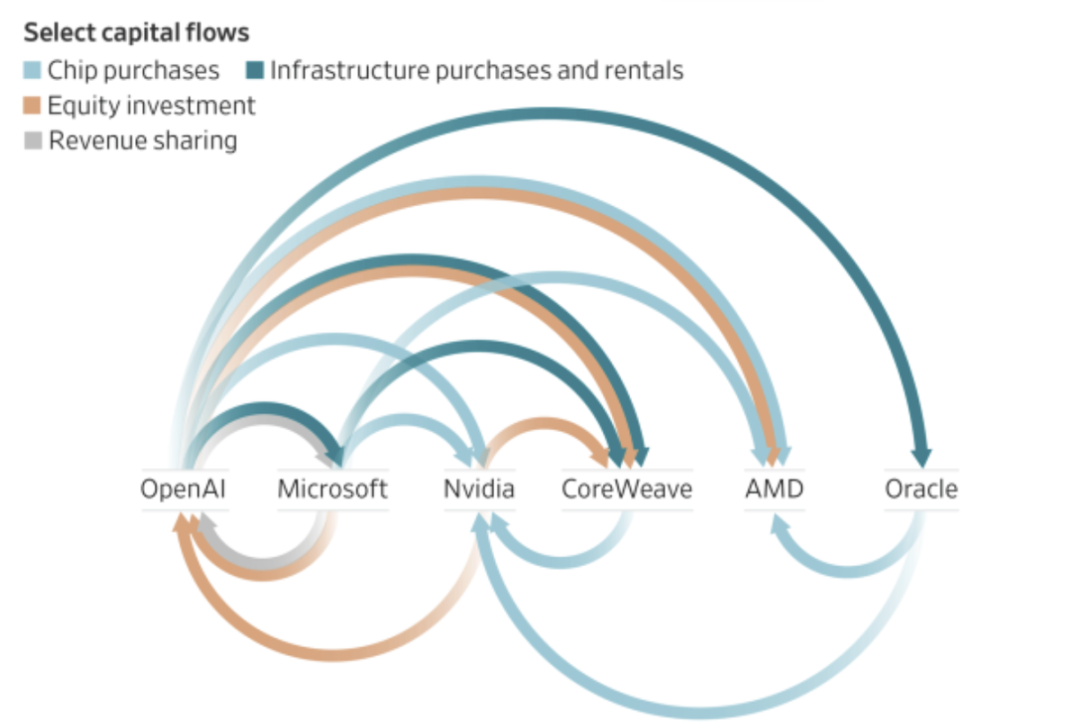

英伟达试图绕过传统云巨头,扶持CoreWeave、Nebius等新兴云平台,通过优先供货、回购协议等方式绑定其GPU生态。但这类新云厂商缺乏真正的技术壁垒,更多是GPU紧缺时期的“渠道代理”,长期竞争力存疑。

微软、谷歌等云服务商则加速自研ASIC芯片(如TPU、Trainium),以降低对英伟达的依赖。值得注意的是,Gemini和Anthropic两大领先模型已基本摆脱英伟达芯片,这直接削弱了后者在算力市场的定价权。客户甚至可凭“转向TPU”的威胁,换取英伟达更优惠的供货条件或股权合作——这本质上是一种变相降价。

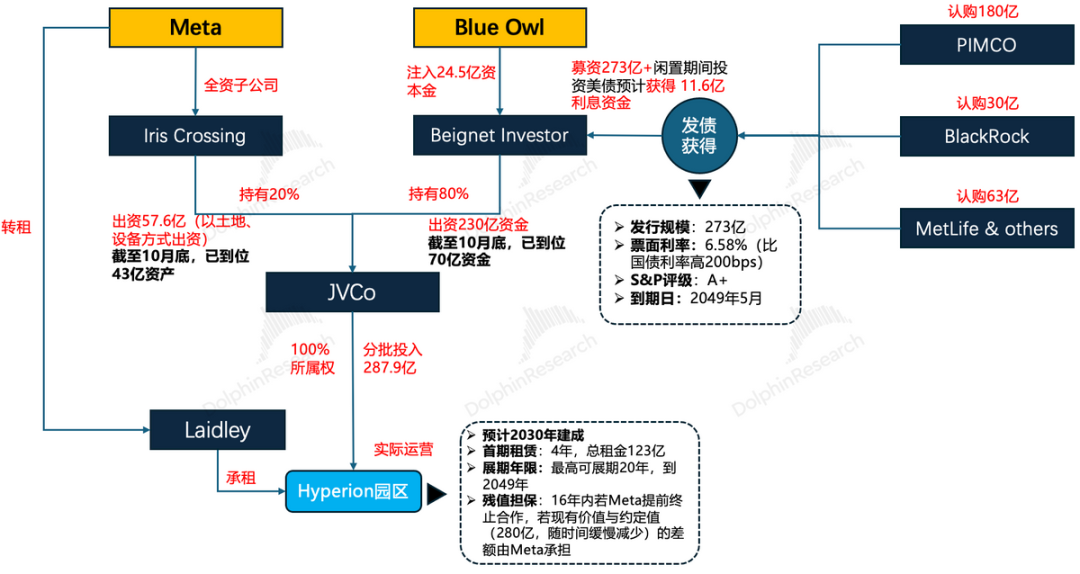

而OpenAI则选择另起炉灶,联合甲骨文等伙伴打造Stargate项目,计划自建10GW算力的数据中心。其CEO奥特曼公开表示“期待多轮算力过剩”,意图通过制造供给宽松压低算力价格,从而推动应用层繁荣。

三、未来展望:利润下移与结构性过剩并存

当前AI产业的核心矛盾,类似于新能源车早期锂矿企业攫取大部分利润,导致整车厂难以盈利的局面。只有当算力成本下降、利润向中下游合理分配,AI应用才可能真正规模化落地。

2026年,投资主线或将聚焦于两个方向:一是算力结构性过剩(如IDC建设滞后于芯片产能),二是产业链利润下移带来的新机会,包括端侧AI硬件(如AI眼镜、机器人)、SaaS产品智能化升级等。

值得警惕的是,英伟达未来或难再享受估值与业绩双升的“戴维斯双击”,而过度押注OpenAI生态链的资产也存在高风险。真正的机会,或许藏在那些能穿越泡沫、实现技术与商业闭环的垂直整合者之中。