当AI浪潮席卷全球,每一次重量级模型的发布都如同点燃引信,引爆新一轮技术讨论。2025年12月2日,法国人工智能新锐Mistral AI正式推出Mistral 3系列模型,这一动作迅速在开发者社区和产业界掀起热议——这个被寄予厚望的新一代模型家族,是否真能撼动当前由少数巨头主导的AI格局?

工具地址:Mistral AI网页版官网(海外网站需科学上网)

Mistral 3系列模型全解析

Mistral 3系列并非单一模型,而是一个覆盖多场景需求的完整产品矩阵,包含3B、8B、14B三款轻量级密集模型,以及性能登顶的Mistral Large3。从智能手机到云端服务器,这套组合拳精准覆盖了从边缘计算到企业级推理的全链路应用场景。过去,高性能AI往往意味着高算力门槛;如今,Mistral 3系列用灵活的模型尺寸与高效的架构设计,让“小设备也能跑大模型”成为现实。

更令人振奋的是,该系列继续采用Apache 2.0开源协议,所有模型权重已同步开放至Hugging Face与GitHub。这意味着开发者不仅可以自由下载、研究,还能将其用于商业项目而无需支付授权费用。这种“零门槛”的开放策略,无异于为全球AI创新者送上了一份厚礼——无需付费,即可站在巨人肩上构建下一代应用。

性能跃升,效率与能力双突破

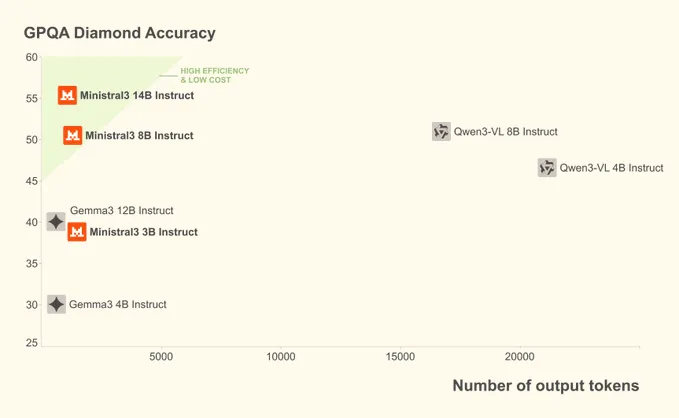

在核心性能方面,Mistral 3系列实现了质的飞跃。不仅延续了前代低延迟、高响应速度的优势,更将上下文窗口扩展至惊人的128K tokens。在MMLU、HumanEval、MT-Bench等权威基准测试中,其表现与Llama3.1同参数规模模型旗鼓相当,甚至在部分任务上小幅领先。这不再是“追赶者”的姿态,而是真正具备了与头部闭源模型正面交锋的实力。

据官方披露,14B版本通过融合“滑动窗口注意力”与“分组查询注意力”机制,在单张A100 GPU上即可高效完成128K上下文的完整推理。而在批量处理场景下,系统吞吐量提升高达42%。对于需要高频生成内容的教育平台、实时分析海量数据的金融企业,或是进行大规模代码生成的研究团队而言,这样的性能提升直接转化为成本优势与用户体验的双重升级。

亲民定价,打破AI使用壁垒

Mistral AI联合创始人兼首席科学家Guillaume Lample强调:“我们的目标是终结高性能AI被少数供应商垄断的局面。无论预算多少,每位开发者都应有权使用顶尖模型。”为此,Mistral Large3已在官方平台Le Platforme上线API服务,输入价格为每百万token 0.8美元,输出为2.4美元——仅为GPT-4o定价的一半,并支持微调与私有化部署,进一步降低企业集成门槛。

价格对比

| 模型 | 每百万token输入价格(美元) | 每百万token输出价格(美元) |

|---|---|---|

| Mistral Large3 | 0.8 | 2.4 |

| GPT - 4o | 约1.6 | 约4.8 |

显而易见,Mistral Large3以极具竞争力的价格,为预算有限的中小企业、高校实验室及公共机构提供了高性能AI的可行路径。这种“平价高端”策略,有望加速AI技术在非头部市场的普及。

推动多极化,重塑AI生态格局

业内普遍认为,依托欧洲严格的GDPR合规基础与彻底的开源策略,Mistral 3系列将在注重数据主权与成本控制的市场中快速渗透。它的出现,不仅是技术上的突破,更是对当前AI基础设施“寡头垄断”格局的一次有力挑战。随着更多开发者加入其生态,一个更加多元、开放、去中心化的AI竞争格局正在形成。

与此同时,Mistral AI持续深化与云服务商、开源社区及行业伙伴的合作,不断丰富工具链与应用场景。这种开放共赢的姿态,正为其在全球AI竞赛中赢得越来越多的战略支点。

总结与发展

Mistral 3系列的发布,标志着开源AI正从“可用”迈向“好用”乃至“超越闭源”的新阶段。凭借卓越性能、极致性价比与坚定的开放立场,它不仅吸引了开发者的目光,更可能成为推动AI民主化进程的关键力量。

展望未来,随着应用场景的不断拓展与社区生态的持续繁荣,Mistral 3系列有望在智能客服、科研辅助、内容创作乃至政务系统等多个领域落地生根,真正让先进AI技术惠及更广泛的群体。这场由欧洲掀起的技术风暴,或许才刚刚开始。