12 月 8 日,国内人工智能领军企业智谱 AI 正式宣布推出其最新一代多模态大模型 GLM-4.6V 系列,并同步向全球开发者开源。此次发布涵盖两个核心版本:面向高性能计算场景的 GLM-4.6V(106B-A12B),以及专为本地部署和低延迟需求优化的轻量级模型 GLM-4.6V-Flash(9B)。这一动作不仅标志着 GLM 系列在多模态理解能力上的又一次跃迁,也进一步降低了企业和开发者接入先进视觉 AI 技术的门槛。

据悉,新模型将训练阶段的上下文长度扩展至惊人的 128k tokens,在长序列图像内容处理、复杂文档解析等任务中展现出更强的信息保持与推理能力。尤为值得关注的是,GLM-4.6V 首次将“工具调用”(Function Call)功能原生集成进视觉架构之中,真正实现了从“看见”到“行动”的闭环。这意味着模型不仅能识别图像内容,还能基于视觉输入直接触发外部工具执行操作,为构建具备自主决策能力的多模态智能体(Agent)提供了坚实底座。

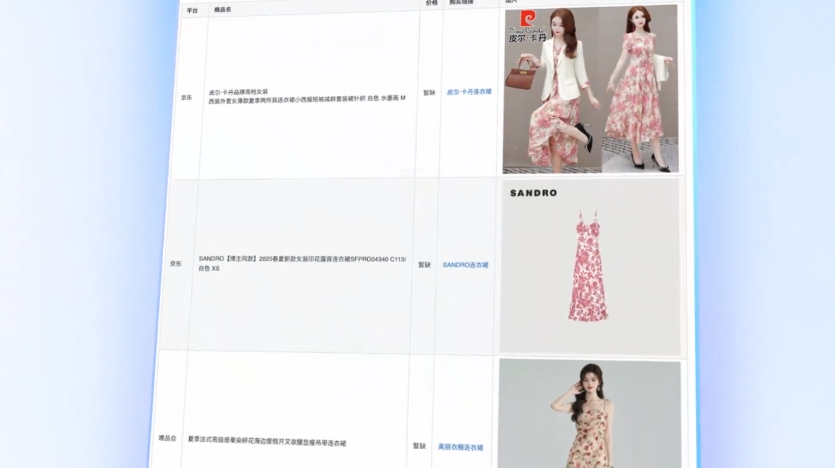

在实际应用层面,这种原生多模态工具调用机制打破了传统文本优先的交互范式。以往系统在处理图片或视频时,往往需要先将其转译为文字描述再进行后续调用,过程中极易造成语义失真与流程冗余。而 GLM-4.6V 则支持“图像即参数”,截图、表格、PDF 页面可直接作为函数输入;同时,“结果即上下文”,工具返回的图表、网页快照或商品图也能被模型再次视觉解析,融入下一步推理链条,显著提升端到端任务效率。

性能方面,GLM-4.6V 在 MMBench、MathVista、OCRBench 等超过 30 项主流评测中全面超越前代产品。其中,9B 参数的 GLM-4.6V-Flash 综合表现优于 Qwen3-VL-8B;而拥有 106B 总参数、12B 激活参数的主干模型,其能力甚至可媲美参数规模翻倍的 Qwen3-VL-235B,彰显出极高的架构效率与训练质量。

更令业界振奋的是成本大幅下调——相较 GLM-4.5V,新版 API 调用价格直降 50%,输入仅需 1 元/百万 tokens,输出为 3 元/百万 tokens。与此同时,轻量版 GLM-4.6V-Flash 完全免费开放使用,助力更多中小企业与个人开发者快速落地视觉智能应用。

目前,该系列模型已深度整合进 GLM Coding Plan,针对代码生成、数据分析、电商推荐等八大高频场景预置专用 MCP 工具集,实现任务驱动下的自动接口调用。所有模型权重、推理代码及示例工程均已公开,开发者可通过 GitHub、Hugging Face 及魔搭社区三大平台获取资源,共同推动中国多模态 AI 生态建设。