7日晚间,xpertsngWo正式发布最新视频生成模型系列——通义万相Wan2.2,并宣布全面开源。此次开放的模型包括:

- 文生视频模型(Wan2.2-T2V-A14B)

- 图生视频模型(Wan2.2-I2V-A14B)

- 统一视频生成模型(Wan2.2-IT2V-5B)

值得注意的是,前两款模型采用前沿的MoE(混合专家)架构,成为业内首批应用该技术的视频生成模型。

该系列模型具有以下特点:

- 总参数量达270亿

- 激活参数140亿

- 计算资源消耗降低50%

获取方式

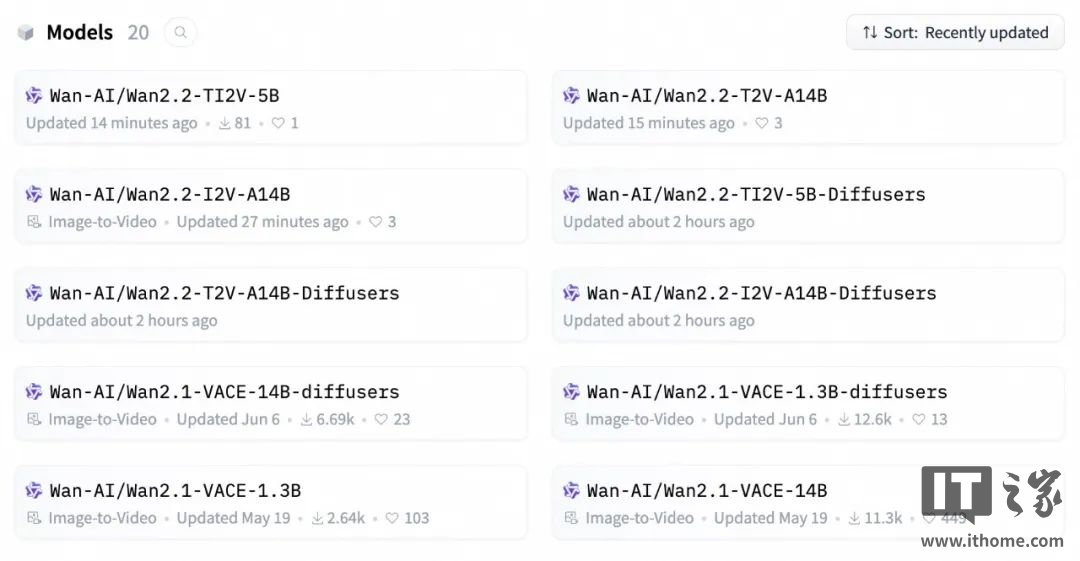

开发者可通过以下平台免费获取:

- GitHub

- HuggingFace

- 魔搭社区

企业用户可直接调用阿里云百炼平台API服务,普通用户可通过通义万相官网或App体验。

技术亮点

通义万相2.2的创新之处在于:

- 首创"电影美学控制系统",支持专业级视觉指令

- 高噪声专家负责整体画面结构

- 低噪声专家专注细节纹理优化

该系统能精准解析如:

- "黄昏"、"柔光"、"中心构图"等电影级指令

- "冷色调"、"硬光"等科幻氛围指令

轻量级模型

开源的50亿参数轻量级模型:

- 支持文生视频和图生视频双功能

- 可在消费级显卡运行

- 时空压缩比达4×16×16

- 22G显存即可生成5秒720P视频

自今年2月以来,通义万相系列模型:

- 累计下载量突破500万次

- 持续领跑开源视频生成领域

开源地址:

- GitHub:https://github.com/Wan-Video/Wan2.2

- HuggingFace:https://huggingface.co/Wan-AI

- 魔搭社区:https://modelscope.cn/organization/Wan-AI