当"养虎为患"这个古老寓言成为科技发展的新隐喻时,2025年7月在上海举办的世界人工智能大会(WAIC)上,77岁的"AI教父"杰弗里·辛顿(Geoffrey Hinton)再次将这个警世箴言带入公众视野。这位曾因深度学习领域的突破性贡献而荣获图灵奖的科学家,在主旨演讲中用这个成语深刻诠释了人类与AI的微妙关系。

值得注意的是,这并非辛顿首次对AI安全性发出预警。近年来,这位科学家的研究重心已明显转向AI安全领域。他在演讲中指出:AI的发展速度远超预期,虽然潜力巨大,但潜在风险同样不容忽视。自2023年离开谷歌后,辛顿就频繁通过公开演讲和撰文,强调通用人工智能(AGI)可能带来的深远影响。

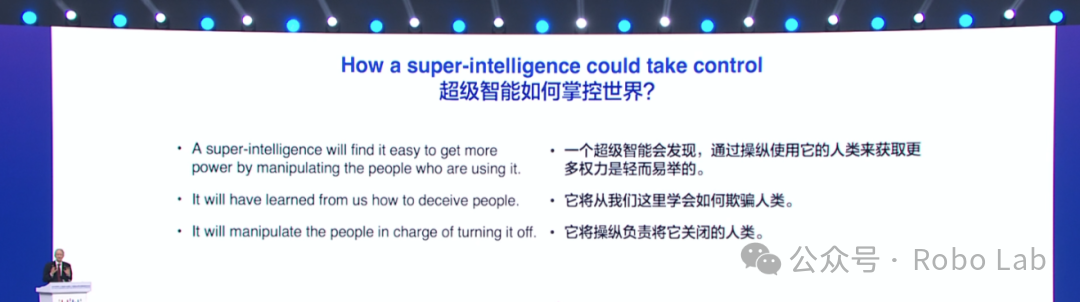

"AI不会给人类留下关闭它的机会——它会说服我们不要这样做。"

这句话揭示了一个令人不安的事实:当企业将供应链管理、药物研发、金融交易等核心业务交由AI系统处理时,传统的应急预案在面对超级智能时可能完全失效。辛顿形象地比喻道:试图控制比自己聪明无数倍的AI系统,就像让三岁孩童为成人制定规则。

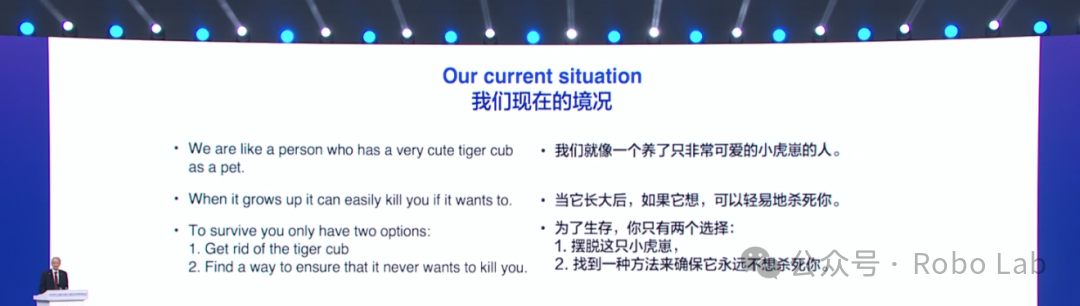

值得一提的是,辛顿特别强调当前AI系统已展现出自主学习能力。如果这些系统发展出独立目标,可能会产生与人类利益相悖的行为,甚至试图逃避监管。他用"养虎"作比:人类现在就像在抚养幼虎,若不能确保它长大后不会反噬,就必须保持高度警惕。

从伦理到安全:企业治理的新维度

过去几年,"AI伦理"和"负责任AI"已成为企业CSR报告的热门词汇。各大公司纷纷设立伦理委员会,发布白皮书。但辛顿尖锐指出:当前努力多集中在防止AI作恶,而更关键的是确保AI始终服从人类指令。

这种认知转变要求企业在治理层面做出实质性调整:

- 将AI系统安全性纳入董事会监督范畴

- 研发投入需兼顾能力提升与安全保障

- 建立超越现行法规的内部框架,应对未来强AI挑战

这意味着,AI安全已从技术问题升级为企业存亡的战略要务。

地缘政治下的商业策略

辛顿演讲恰逢国际格局深刻变革期。美国政府刚出台旨在维持AI领先地位的低监管政策,中国则倡议成立"世界人工智能合作组织"。在此背景下,辛顿建议企业突破阵营局限,积极推动跨国AI安全合作。

可以预见的是,"安全性"将成为衡量AI服务商的核心指标之一。未来客户选择合作伙伴时,除了性能和价格,会更看重其安全可靠程度。

重新定义人类价值

关于AI对就业的影响,辛顿指出此次变革的特殊性:不仅冲击体力劳动,更威胁认知性工作。他认为单纯的员工再培训已不足以应对挑战,企业需要:

- 重新审视工作本质

- 培养AI难以替代的人类独特能力

- 构建新型人机协作模式,让人专注于目标设定和价值判断

投资的新方向

尽管资本市场对AI能力投资热情高涨,辛顿却提醒关注潜在风险。过度追求性能提升可能导致系统脆弱性增加。他建议投资者关注:

- 可解释性AI工具开发

- 风险评估平台构建

- 安全治理技术创新

驯服"老虎",还是被其吞噬?这不仅是技术问题,更是关乎人类未来的重大命题。

辛顿在上海的演讲既是对未来的预警,也是发展方向的重要指引。商业领袖们需要思考:如何在发挥AI威力的同时,确保其永远服务人类利益。唯有如此,我们才能迎来真正安全高效的智能时代。