在影视科技与数据安全日益交织的今天,谷歌DeepMind团队再次引领风潮,推出了一款名为VaultGemma的革命性语言模型。这款模型不仅延续了Gemma系列的技术优势,更在用户隐私保护层面实现了前所未有的突破。作为当前全球最大规模且开源的具备差分隐私能力的语言模型,VaultGemma拥有高达10亿参数,标志着AI技术在兼顾强大性能与数据安全方面迈出了坚实一步。

长期以来,大语言模型在训练过程中存在潜在风险——它们可能无意中“记住”并泄露敏感信息,如个人身份、通信内容甚至机密文件。这种隐患让许多行业对AI的应用持谨慎态度。而VaultGemma则通过引入先进的差分隐私机制,从根本上改变了这一局面。该技术在训练阶段向数据注入可控的随机噪声,使得最终模型无法追溯到任何具体的训练样本。即便模型曾接触过高度机密的数据,在统计学意义上也几乎不可能还原原始内容。谷歌实测表明,VaultGemma在整个运行过程中未出现任何训练数据泄露现象,极大增强了用户对其的信任度。

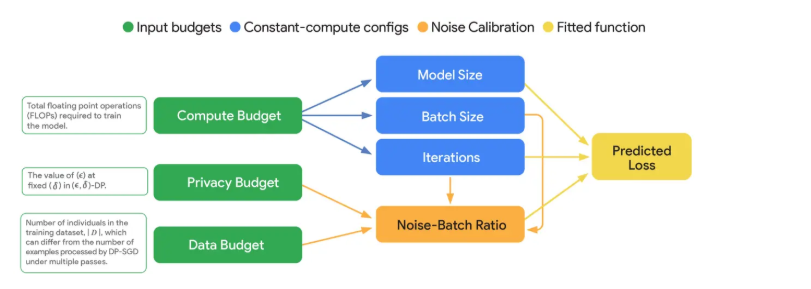

从架构设计来看,VaultGemma基于成熟的Gemma2框架构建,采用仅解码器的Transformer结构,共包含26层网络,并集成了高效的多查询注意力机制。为应对差分隐私带来的高计算负荷,研发团队将输入序列长度限定在1024个Token以内,从而优化资源分配与处理效率。尤为值得关注的是,项目组创新性地提出了“差分隐私缩放定律”,这一理论框架有效平衡了算力投入、隐私保障强度以及模型实际表现之间的关系,为后续研究提供了宝贵的参考路径。

尽管其生成能力相较于当下主流模型略显稳健,大致相当于五年前的标准水平,但VaultGemma的核心价值并不在于极致的文本流畅度,而是为用户提供了一个真正可信赖的私有化AI解决方案。谷歌已宣布,VaultGemma及其完整代码库将通过Hugging Face和Kaggle平台以开源形式发布,旨在降低技术门槛,推动隐私优先型AI在全球范围内的普及与应用。

随着公众对数字隐私的关注持续升温,VaultGemma的问世不仅是技术上的飞跃,更是理念上的革新。它证明了开源与安全并非对立面,反而可以相辅相成。未来,这类注重隐私保护的模型有望广泛应用于医疗、金融、法律等敏感领域,为人工智能的可持续发展树立新的标杆。