10 月 21 日讯,日本通信巨头 NTT 于当地时间 20 日正式发布其最新研发的轻量级人工智能模型——tsuzumi2。这款专为日语环境深度优化的 AI 模型,尽管拥有高达 300 亿(30B)的参数规模,却展现出惊人的运行效率:在推理阶段仅需约 30GB 的内存空间,这意味着一张市面上常见的 NVIDIA A100 40GB 显卡便足以支撑其运行。这一特性极大降低了部署门槛,使得企业或个人用户能够在本地设备或私有云环境中轻松运行该模型,从而有效规避了敏感数据上传至公共云平台所带来的安全风险,为金融、政务等对数据隐私要求极高的领域提供了理想的解决方案。

回顾 tsuzumi 系列的发展历程,NTT 在 2023 年便推出了初代 tsuzumi 模型,其初衷便是为日本本土市场打造一款高效、安全且易于部署的 AI 工具。然而,在初代模型投入实际应用后,来自政府机构和大型企业的用户反馈集中于模型在处理复杂专业文档、理解特定领域术语以及应对高难度知识问答时的表现仍有提升空间。这些来自一线的真实需求,直接催生了 tsuzumi2 的研发。可以说,tsuzumi2 并非一次简单的技术迭代,而是 NTT 倾听市场、直面挑战后,针对政企用户核心痛点进行的一次精准“升级”。

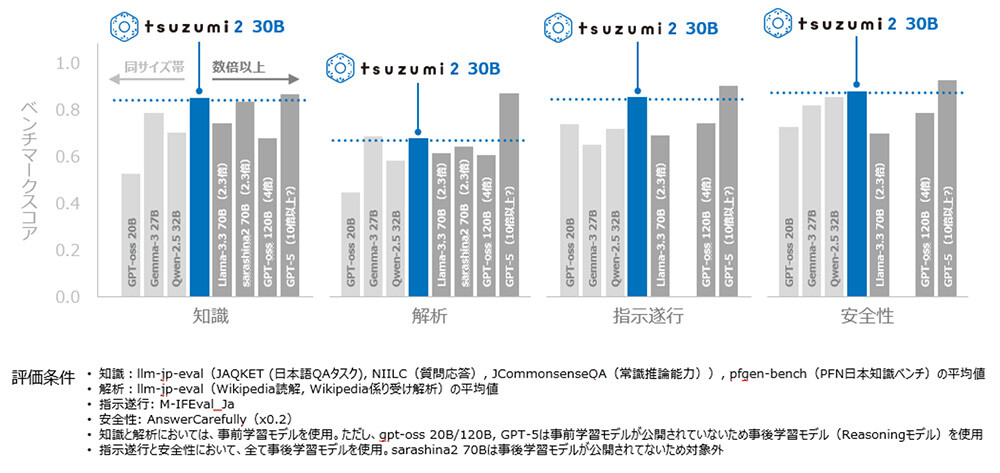

NTT 对 tsuzumi2 的性能表现充满信心。官方宣称,该模型在日语语境下的综合能力,已达到同参数级别模型中的顶尖水准。更值得关注的是,通过结合 RAG(检索增强生成)技术以及针对特定场景的微调(Fine-tuning),tsuzumi2 在金融分析、医疗诊断辅助、公共政策解读等垂直领域的专业表现获得了显著增强。NTT 甚至透露,在其内部业务测试中,经过优化的 tsuzumi2 在处理特定日语专业任务时,其效果已经超越了业界标杆 GPT-5。这一论断无疑将 tsuzumi2 推向了聚光灯下,不仅彰显了日本在 AI 领域的自主研发实力,也预示着未来大模型竞争将更加注重本地化、专业化和安全性,而非一味追求参数膨胀。tsuzumi2 的出现,或许正是这一趋势的先行者。