2025年11月26日,Safe Superintelligence(SSI)创始人、前OpenAI首席科学家伊利亚·苏茨克维(Ilya Sutskever)在知名科技播客主持人德瓦克什·帕特尔(Dwarkesh Patel)的访谈中抛出一枚重磅观点:“那个依靠海量数据与算力堆砌的‘Scaling Law时代’(2020–2025)已然终结,我们正重返一个需要重新探索算法本质与数据配方的‘研究复兴期’。”

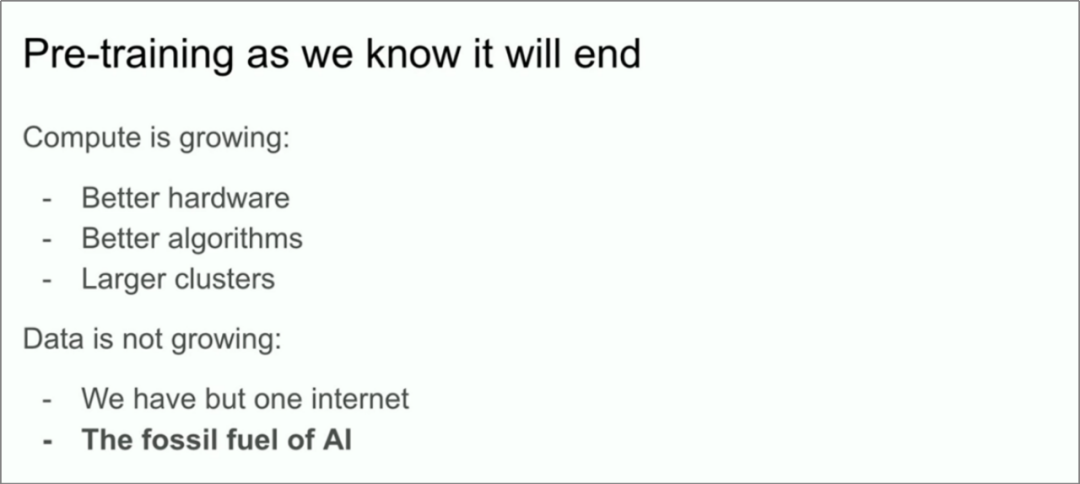

这一论断并非空穴来风。早在2024年的NeurIPS大会上,苏茨克维就已明确指出:预训练模型依赖互联网规模的数据,而后者存在天然上限,因此“预训练时代终将落幕”。此番重申,更显其判断之坚定。

之所以这一观点在业内激起强烈回响,正是因为苏茨克维本人正是“Scaling Law”最有力的践行者与布道者。当年他主导GPT-3项目,以1750亿参数的庞然巨构向世界验证了“规模即智能”的可行性,一度让整个行业笃信:只要堆得够大,就能逼近通用智能。如今,这位昔日Scaling Law的旗手却亲手为其划下句点,其转变本身就构成一种深刻的技术哲学信号。

但这种“转向”并非立场摇摆,而是源于苏茨克维一贯的“自上而下”思维范式——他始终以对“智能本质”的理解为最高准则。早期他相信扩大规模是通向智能的正确路径;而当模型在基准测试中表现惊艳,却在真实世界中频频失灵时,他意识到:仅靠规模无法弥合“能力幻觉”与“泛化现实”之间的鸿沟。于是,他果断调整方向,指出当前主流强化学习方法不仅能耗惊人,更在根本上难以支撑真正意义上的智能泛化。

作为被导师杰弗里·辛顿誉为拥有“惊人原始直觉”的研究者,苏茨克维兼具工程实现力与哲学思辨力。他从不盲从技术潮流,而是不断将新现象纳入自身严密的认知框架中进行校准。这种特质,使他总能站在浪潮之巅,凝视更远的地平线。

回溯其成长轨迹,苏茨克维1986年生于俄罗斯,少年移民以色列,后定居加拿大,在多伦多大学师从“深度学习教父”辛顿。2012年,他与同门Alex Krizhevsky共同打造AlexNet——他负责GPU集群搭建与高性能代码实现,为这一引爆深度学习革命的模型提供了关键算力支撑。

2013年,谷歌以4400万美元收购其团队,苏茨克维加入Google Brain。期间,他与Oriol Vinyals等人提出Seq2Seq架构,首次实现端到端变长序列建模,彻底革新自然语言处理范式;同时,他也是TensorFlow核心论文作者之一,为全球AI开发者铺就了工程基石。

2015年,他毅然离开谷歌,联合马斯克、奥尔特曼创立OpenAI,矢志打造“非营利、安全优先”的AGI平台。在其领导下,GPT-1至GPT-4、DALL·E、ChatGPT相继问世,每一款产品都重塑行业认知。尤其GPT-3,不仅验证了Scaling Law的有效性,更催生了提示工程与大模型生态。

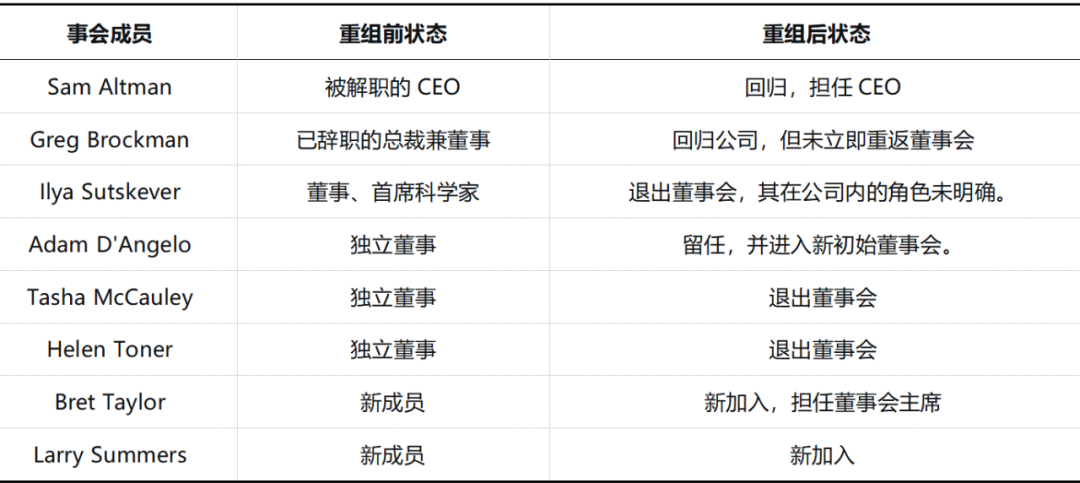

然而,他对安全的执念与公司商业化节奏日益冲突。2023年,他牵头成立“超级智能对齐”项目,主张投入20%算力专攻对齐难题。同年11月,因与CEO萨姆·奥尔特曼在发展路线上不可调和,他联合董事会罢免后者,却引发员工集体倒戈。短短数日后,奥尔特曼强势回归,苏茨克维被边缘化,并于2024年5月离职。

同年6月,他创立SSI,誓言“只做一件事:开发安全的超级智能”,拒绝产品干扰与短期盈利压力。公司迅速获红杉、a16z等顶级机构青睐,估值在一年内飙升至320亿美元。即便联合创始人被Meta挖角,苏茨克维仍亲自掌舵,坚定前行。

从AlexNet到GPT-3,再到今日对Scaling Law的“自我否定”,苏茨克维的每一步,都是对智能本质更深层的叩问。他的转身,或许正预示着AI下一个十年的真正起点。